Claude Code, Codex, OpenClaw,我是怎么让它们配合干活的?

重器轻用,而不事必躬亲

疑问

知识星球里,星友阿熙问我:「请问下王老师是怎么协同 OpenClaw 和 Claude Code(或 Codex)之间的工作的?」

这个问题问得好。我尝试过各种不同的组合方式,踩坑无数。今天我就借这个机会,把整个尝试的心路历程完整地分享给你。

兴奋

跟很多人一样,在 GPT 5.4 出现之前的一段时间,ChatGPT 已经基本上被我打入冷宫了。平时可用的选择实在太多,我根本想不起来用 ChatGPT 以及 OpenAI 的其他产品有什么独特之处。

其实去年夏天还不是那样的。当时我对 OpenAI 那套工具的喜欢程度要高于 Claude Code,因为我发现有的时候 Claude Code 在那转来转去解决不了的问题,OpenAI 直接一击而中。我甚至在第五届开智大会的圆桌嘉宾讨论环节,还专门在回答观众疑问的时候提到过这件事。那时候我还订阅了 OpenAI 的 Pro 订阅,价格不菲啊。

但后来 Claude Code 发展得越来越好。它主要是把「服务人们完成复杂工作」这件事做到了极致。特别是当它能够调用子 Agent,非常方便地完成任务的时候。我之前还专门为你写过一篇 《AI Agent 查不出自己的错,怎么办?》,谈的就是这个事儿。

实际上当 Claude Code 能够调动子 Agent 的时候,已经是在用另外一双眼睛来审视执行的效果。我当时觉得效果很好,所以想象不出为什么要替换掉 Claude Code。

但是 GPT 5.4 的出现,让我瞬间感受到了 —— 原来我对 Claude Code 还有这么多不满的地方。

最大的问题就是执行速度。如果你使用的是 Medium Reasoning Effort 来执行 Codex,速度是非常快的。同样是完成一个平时的任务 —— 比如说做一个调研、生成一些包含了动态图的网页 —— 你把这事儿交给 GPT 5.4 加上 Codex 的时候,那个执行速度真的让人惊诧。

当然有人会说 Medium 思考设定本身思考能力不是很强,在完成复杂任务的时候可能不够用。那没关系,你可以上 High Reasoning Effort,马上你会感到它变聪明了。如果还是觉得不满,你还可以上 Extra High,但我觉得对于一般任务,那有点太过于夸张了。

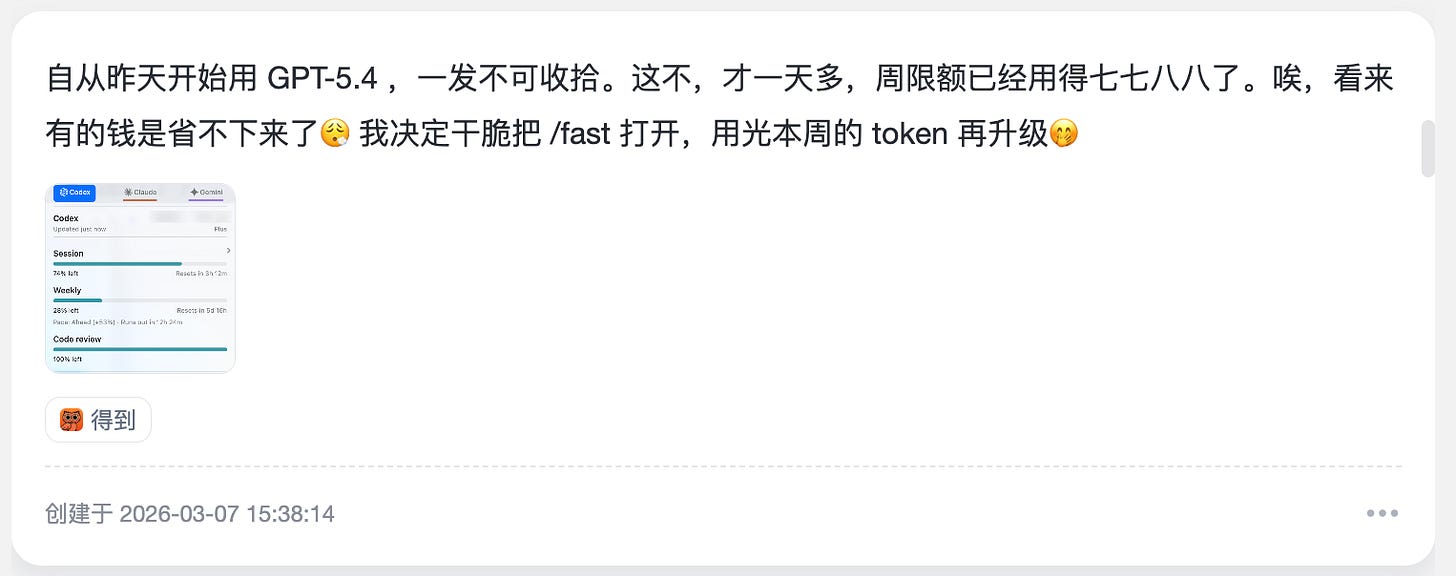

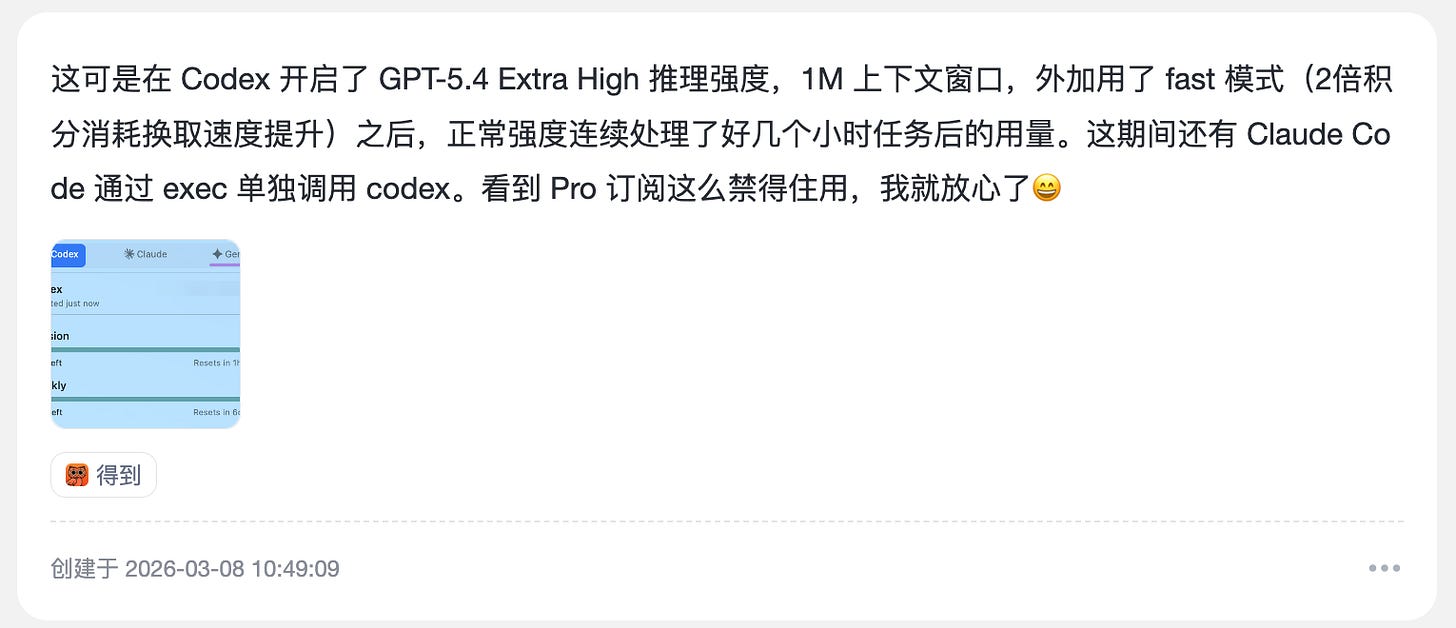

可是你上了 High Reasoning 之后突然发现速度下来了怎么办?没关系,Codex 专门提供了一个 Fast 模式 —— 开了之后速度大概快 1.5 倍,当然花费差不多也是两倍。

我没有任何犹豫就把这个选项开启了。在迅速耗光了我的 Token 之后,我干了一件事 —— 从 Plus 重新升到了 Pro。

说实在的,对我来说 200 美金一个月还是非常肉疼的。但我觉得既然 GPT-5.4 出现,必须体验一下这些顶级模型之间究竟有什么差异。

然后我突然发现 GPT 5.4 提供了一个除了速度之外让我非常喜欢的东西 —— 它可以把上下文窗口开到 1M,而不是原来的 200K。

差别是非常大的。自从我把窗口调大之后,就再也没遇到过需要手动进行上下文压缩的情况。同样的任务,我这边开着 Codex,那边开着 Claude Code。只要偶尔往 Claude Code 那边扫一眼,基本上它都在忙着做上下文压缩,这个动作耗时特别长。相比之下,Codex 这边一直行云流水地往下执行。

这种差异带给我一种说不出来的喜欢。相对而言,那种三天两头需要压缩上下文的情况,一方面让你必须耐心地等待,另一方面用起来也小心翼翼,生怕压缩到后来出现「无法再压缩」的惨状。

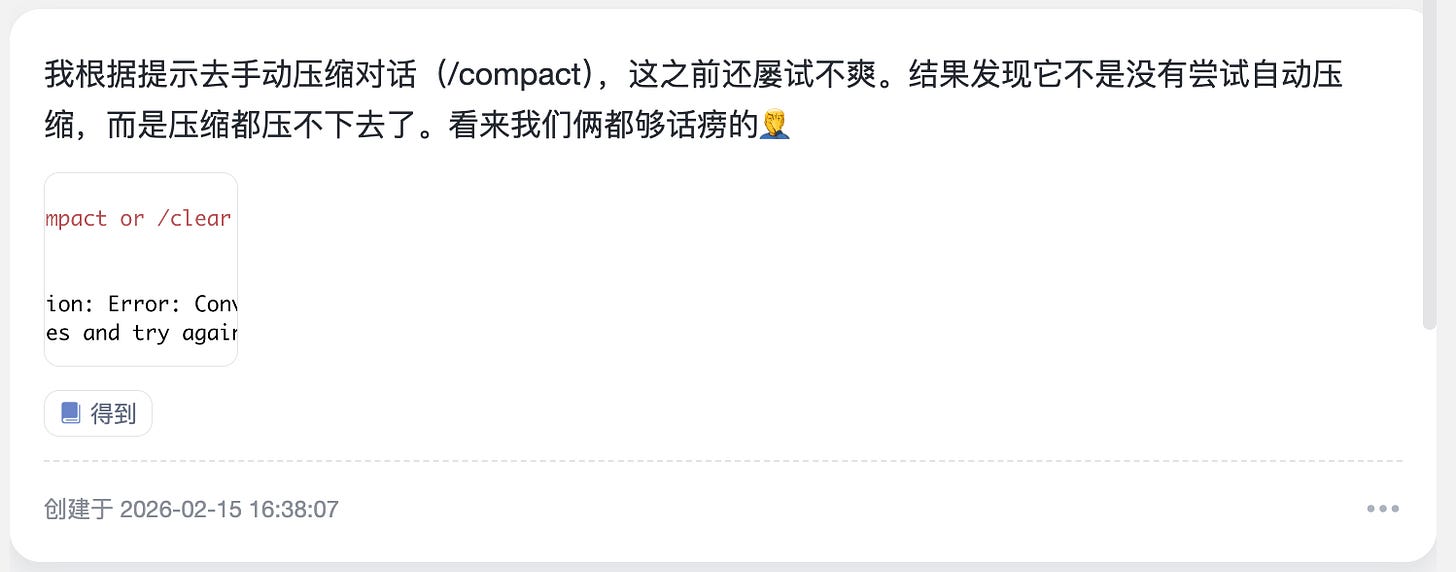

我之前真遇到过那种情况,非常麻烦。

遇到这种报错,就意味着你必须新开一个对话,还得想办法把之前的对话内容手动提取出来提供给它。我觉得所有的上下文动态处理都应该由 AI 自己搞定,而不应该由我来手动投喂,否则和我直接去开一个网页版对话还有什么区别?

退烧

但是我这种对 ChatGPT 新模型的兴奋并没有能够一直持续。我很快就发现了一些问题。

GPT 5.4 相对于之前 GPT 5.3 Codex 这类专攻编程的模型,确实是有优势的。它更通用,似乎可以「一个模型打天下」。但我着实不喜欢它的写作能力。它写出来的东西,我看过之后,心头一紧,觉得不能满足需求。

所以我做的第一件事,就是让不同的 AI Agent 配合,解决写作需求。我希望能够在 Skill 流程处理过程中,调用 Claude Code 。这里为了照顾新读者,咱们简单做个名词解释:所谓 Skill,就是你教给 AI Agent 的一套工作流程 —— 比如怎么做调研、怎么排版、怎么写特定风格的文章。

Claude Code 和 Codex 之间的 Skill 是通用的。不过你要注意,Skill 需要配合全局配置来使用,你不可能把所有常见的规则分别记录在每一个 Skill 里,那样同步维护起来会是噩梦。

起初我所有调试好的系统都在 Claude Code 那边,但自从 GPT 5.4 发布后,我有大约三天时间在强度使用 Codex。在一个包含调研、写作、后期处理加工的长任务中,我发现 Codex 在其他方向上执行得都很好 —— 速度快,且不需要频繁压缩上下文。但中间的写作环节成了短板。最后我的选择是:这一部分工作还是得让 Claude Code 来完成。

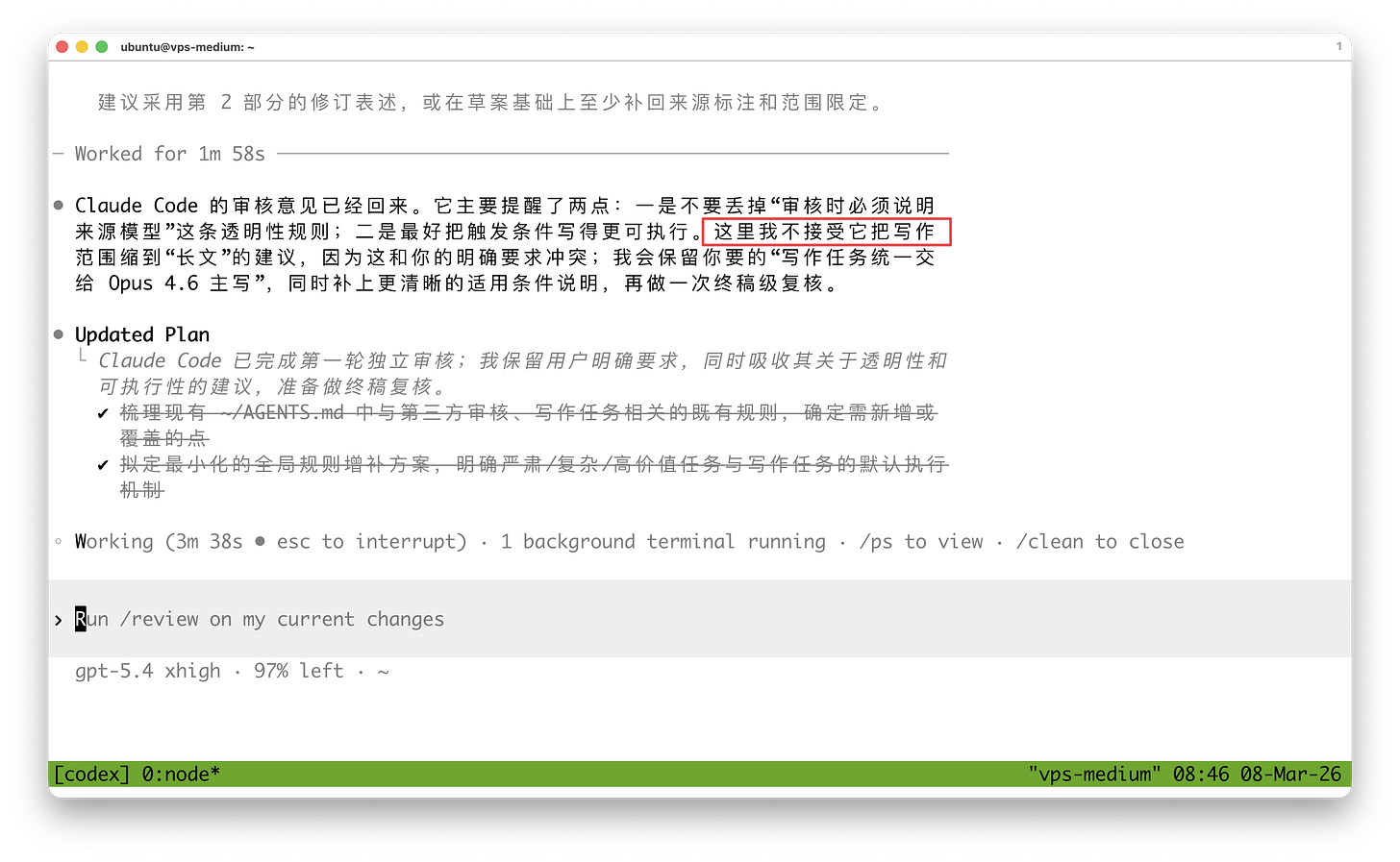

我直接跟 Codex 对话,告诉它:以后但凡你遇到写作任务,不要犹豫,调用一个 Claude Code Opus 4.6 High Reasoning 让它去写。等写完东西回来,你再往下做。

其实事情就是这么简单 —— 主线上都是由 Codex 来完成,支线上我让它把写作任务外包出去。

你可能会说:「老师,你这么讲太敷衍了,你也不告诉我具体怎么设置,我想要具体的参数设定和操作步骤说明。」

倘若是在去年,我觉得你的要求都有道理。但如果你手里现在有上面咱们讨论的这几个工具 —— 也就是至少有一个高能力的 AI Agent 加上一个高能力的大模型 —— 你压根就不需要再自己手动去设置配置、去理解它是怎么做的。

你只需要跟它对话,告诉它两件事:第一、以后遇到这种情况,你就去调用 Claude Code;第二、把这个修改记在合适的配置里,但一定要落盘,不是你的 memory。

如果你还不放心,可以再嘱咐它:

执行过程中,你一定要先查一下 Claude Code 官方最新的权威说明,了解优秀的用户示例,然后再去操作。

对,就这样就可以了。比你一次次自己查文档自行配置,要高效不少;况且,如果你对于命令行操作不是很熟悉,这种方式比起你自己手动改写配置,还更不容易出错。

但后来我发现,我需要让 Claude Code 来完成的,恐怕远远不只是一个写作的问题。

审核

前面说了,当一切顺风顺水的时候,GPT 5.4 的速度快会给你留下非常深刻的印象。它上下文窗口更长,使得常任务运行中间过程没有任何阻碍,行云流水。可是当它遇到错误的时候,你让它去修,你马上就会发现它的问题。它飞快一通动手,然后告诉你改完了;但等你真正去验证的话,发现还是不成。这可能不只是模型的事,而是模型和框架配合的问题。

我决定得再加一层稳定性保证,那就是继续用 Codex 来快速做东西,但是关键位置要让 Claude Code 来审核。

默认情况下,Claude Code 在调用子 Agent 的时候,每次只是调一个 Sonnet 4.6。比起 Opus, Sonnet 的能力不是很强,但能提供一个第三方视角,还是有用的。而 Codex 这边呢,当时它根本就不能开子 Agent ,只能命令行方式调用一个 Codex 进程去做审查。这种方式,我发现效果并不好。不知是命令行方式带来的不稳定,还是上下文割裂,总之审查往往流于形式。

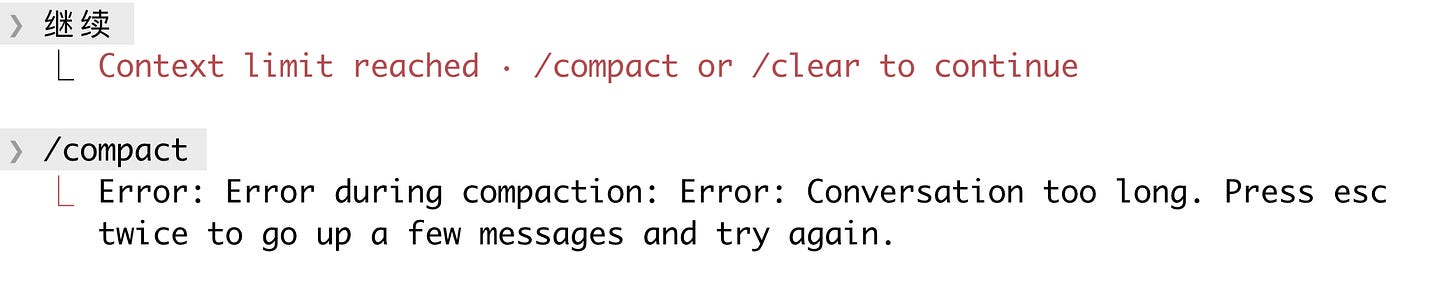

注意这里所说的,都是我彼时彼刻具体应用场景中使用 AI Agent 的体感,不要机械、静态来看。在我这篇文章快写完的时候,Codex 又进行了升级,功能得到改善,例如也可以把任务分派给子 Agent 了。

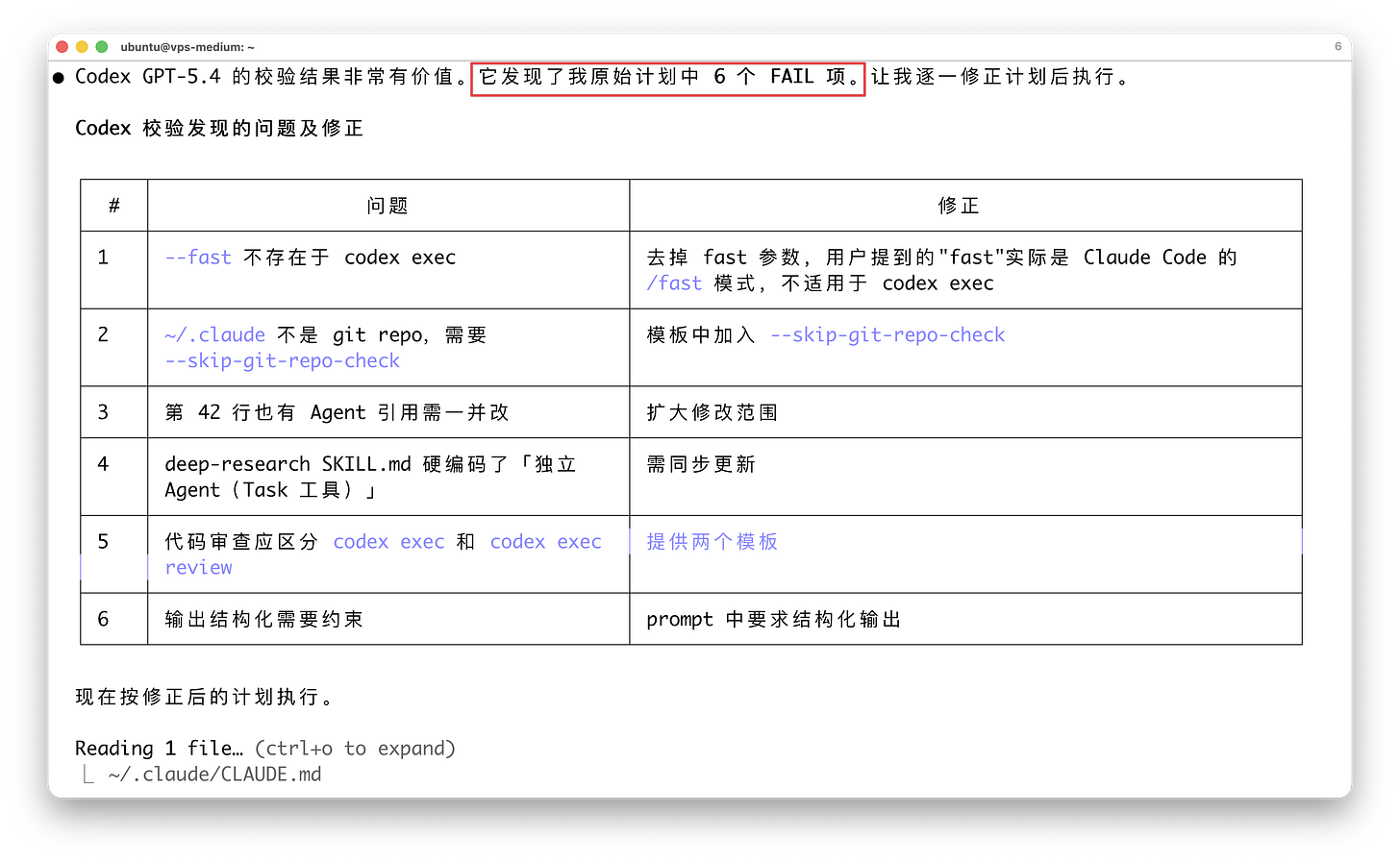

还是回到我使用 Codex 遇到调用独立审核 Codex Agent 稳定性问题时。几次挫折后,我对 Codex 的要求变了。我说:不仅仅是写作任务,其他需要对复杂计划进行审核、或者对复杂产出作品质量进行检验的任务,你也用 Claude Code 来完成。

但我旋即想起来 —— 为什么只在 Codex 当中让 Claude Code 来负责做这些重要的环节检验?反过来,Claude Code 为什么不能使用 Codex 来检验呢?

这两者之间,不管哪一个执行,都有另一个这个星球上目前最强的大模型来帮忙验证、帮忙查错。那岂不是最好的效果?

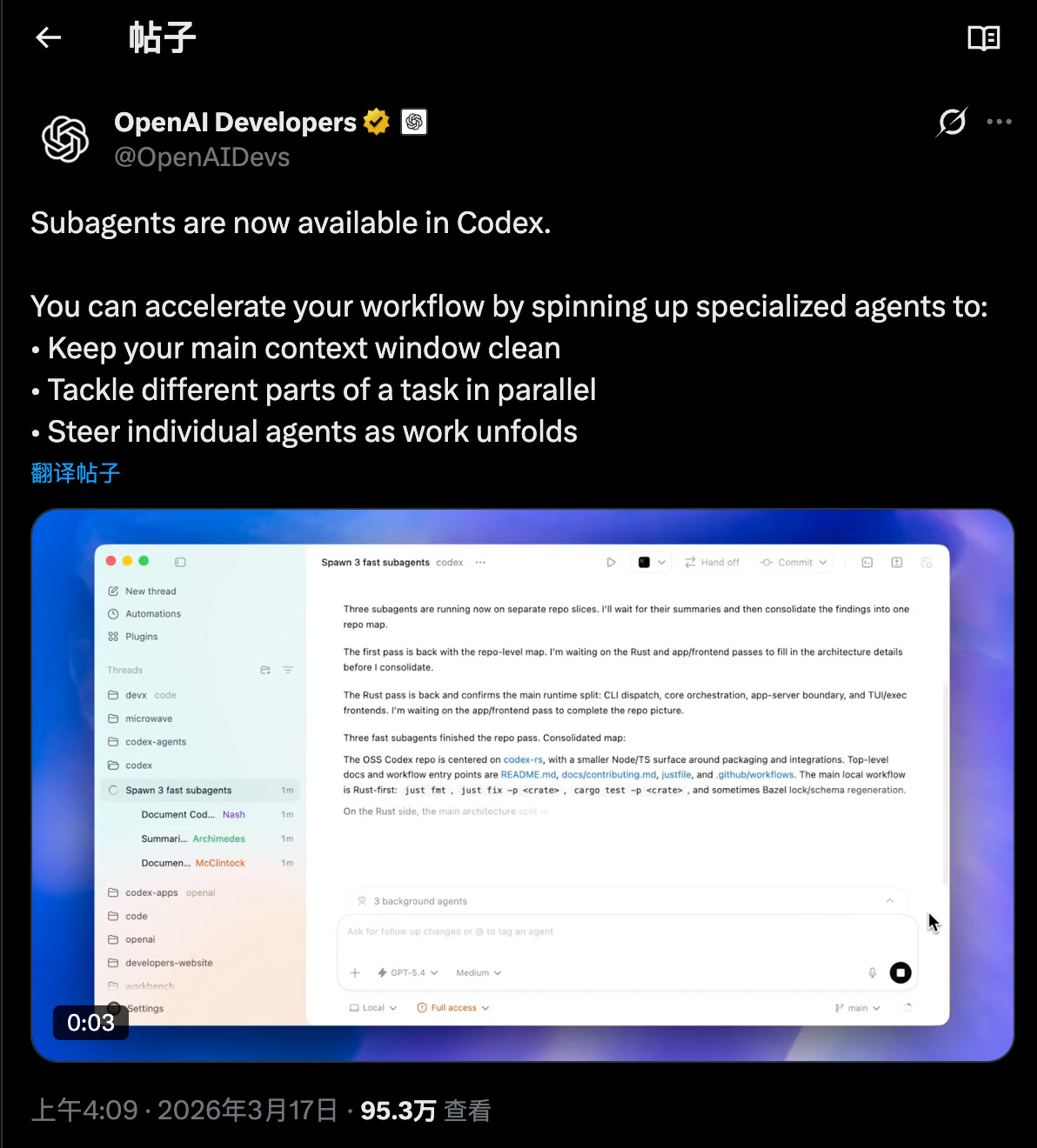

于是我就看到了非常令我震惊的一幕 —— 真的有这种在检验的过程当中,对另一个 Agent 提出来的意见加以反驳的情况。

AI Agent 之间真正形成了一种 check and balance,相互制衡。

我突然间明白了一个事:这就是棋逢对手,将遇良才。我们总说「不要跟臭棋篓子下棋,越下越臭」,大模型之间的讨论也是一样的道理。当这两个聪明的模型可以通过这种方式交互检验、相互切磋和砥砺的时候,你会发现那个感觉是真好。这两大高手一致达成的意见,往往思维非常缜密而周到。如果有些问题是它们无法想周到的,那可以说这个星球上最强的硅基大脑也没有办法来处理了。可能,此时更需要人类的具身认知来介入吧。

不过我这套双线并行的使用方式并没有持续多久,因为后续情况又发生了变化。

Keep reading with a 7-day free trial

Subscribe to Shuyi’s Newsletter to keep reading this post and get 7 days of free access to the full post archives.